- 全部

- 多模态2

- GAN2

- 数组1

- GPT1

- 特征点检测3

- 树的遍历1

- transformer3

- 注意力机制1

- 多视角几何3

- 相机模型1

- 图像变换1

- SpringCloud1

- 并查集1

- 变量1

- 类与对象3

- 博弈论1

- 形态学处理1

- 彩色图像处理1

- 回溯算法4

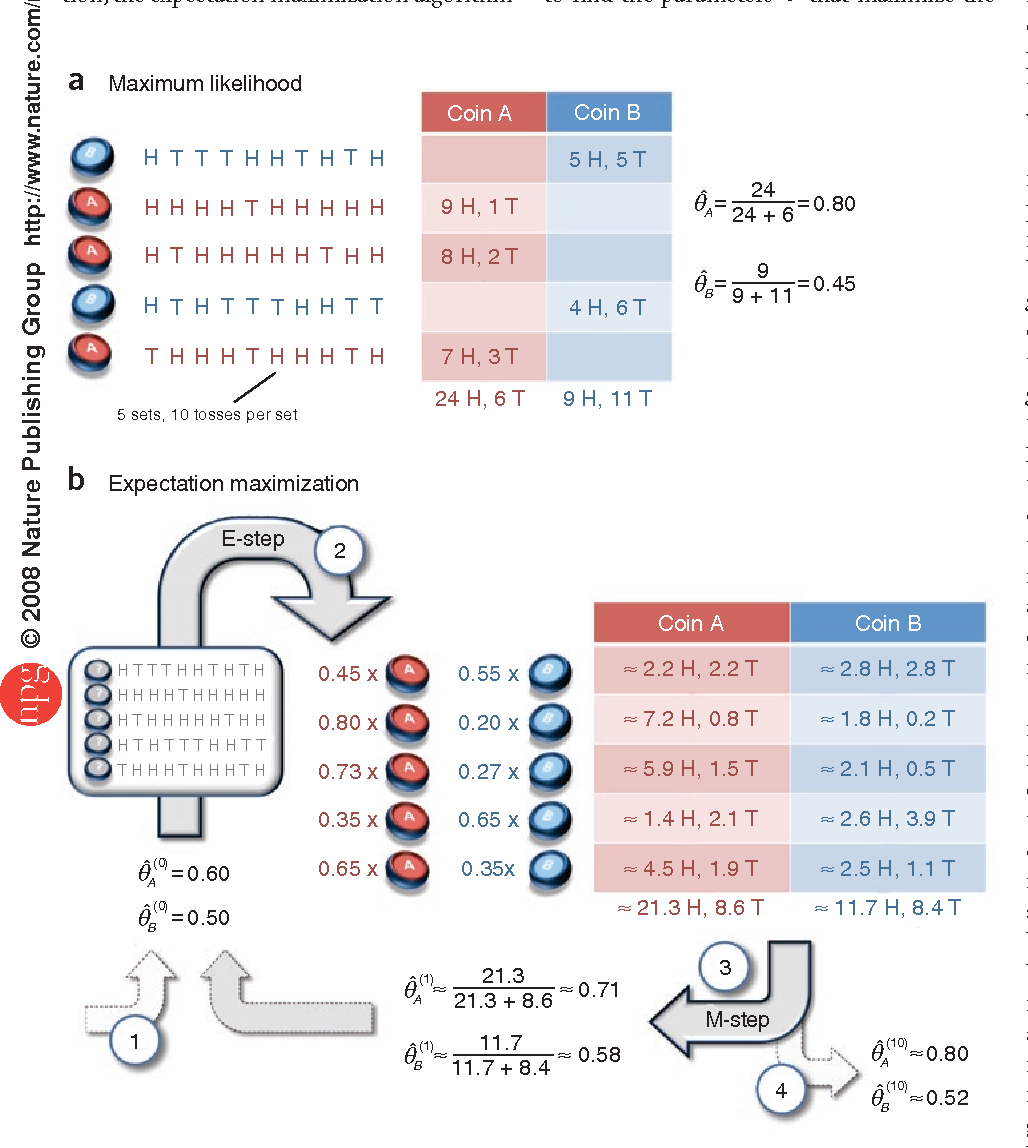

- 概率图模型2

- 双指针3

- 优化算法1

- 小波变换3

- 聚类算法3

- 集成学习1

- 贪心算法7

- 多分辨率技术1

- 动态规划13

- 图像复原1

- 图像去噪3

- 频率域滤波5

- 特征工程1

- 模型优化1

- 空间滤波3

- 数学符号1

- 分词处理1

- 线性判别5

- 矩阵论9

- 灰度变换2

- 分治法6

- 概率论与数理统计1

- Prim1

- 直方图处理3

- 贝叶斯学习1

- 算法分析3

置顶

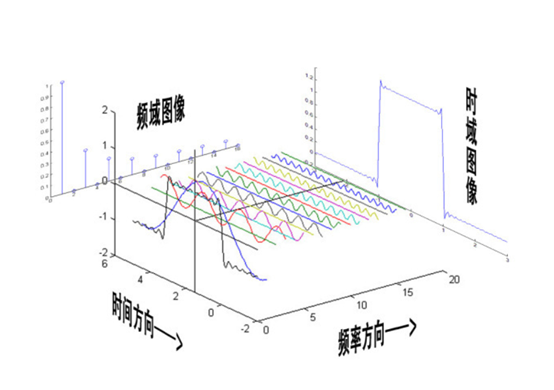

傅立叶变换

数字图像处理——傅立叶变换 欧拉公式 对于一个复平面(对于欧几里得平面而言,把实数作为x轴,虚数作为y轴)

EDITOR'S SELECTION

推荐文章-

推荐

- 推荐

文章列表

请您轻一点,我是很昂贵的机器人哦!

O.O